在分歧、破碎的全球人工智慧監管架構中,特重權利保障的歐盟在近日削弱兩大關鍵數位監管法,似乎顯示在重金競逐的AI競賽中,愈來愈難達成監管與創新的平衡。企業應該如何回應這樣的趨勢?在科技治理學者眼中,哪些風險特別引人擔憂?

在研擬多年後,野心勃勃且立意良善的歐盟AI法案終在2024年生效。如今卻看來更像是歐盟作繭自縛的結果。

11月19日,歐盟執委會宣布提議推遲AI法案部分關鍵內容的生效時程。例如,針對評估貸款申請等這類可能對健康或基本權利構成嚴重風險的「高風險AI系統」,相關監管法規原定在2026年8月生效,現在延後到2027年底。

延期提議還需歐洲議會與歐盟成員國批准。但這是歐盟在美國川普政權的壓力與產業界的反彈下,首次正式承認如此廣泛的AI監管框架有其窒礙難行之處。

訪台參與第八屆人工智慧與法律國際學術研討會的法國巴黎政治大學(Sciences Po)數位、治理與主權講座教授格賽爾(Florence G’sell)在短講中指出,即便歐盟已通過了全面性的AI法律框架,以及《一般資料保護規則》(GDPR)這樣的現行法規,情況仍在演變中,「因為這些法規難以被執行。」

格賽爾目前是美國史丹佛大學科技影響及政策中心(Tech Impact and Policy Center)的訪問教授,也是「新興科技治理研究計畫」主任。她特別關注數位主權、歐盟與美國的數位政策比較,與新興科技帶來的治理挑戰。

大約一年前,曾任歐洲中央銀行行長的義大利前總理德拉吉(Mario Draghi)在2024年9月發布了影響深遠的歐洲競爭力報告。報告指出,在投資不足、過度監管的傾向下,歐盟在人工智慧等前沿戰略科技領域,有落後美國、中國的風險。

面對美、中的競爭壓力,加以AI技術的快速進展,以及歐盟希望捍衛民主進路的努力,讓歐盟透過監管架構打造「可信任AI」來鼓勵採用的初衷,變得難以實現。目前,歐盟正在研擬透過「數位綜合套案」(digital omnibus package)簡化數位法規,甚至考慮犧牲GDPR的部分隱私權保障。

然而,這也造就了巨大的合規不確定性。格賽爾提到,自己在法國的律師同業近期甚至不確定可以如何為客戶提供建議,只能等待歐盟進一步的澄清。

「這是一個非常複雜的過程。」格賽爾表示,「這也說明了,即便通過了雄心勃勃的法規,仍然可能存在法律不確定性。」

歐盟推出修正案,在既有體制中盡力適應新技術演進

在專訪中,格賽爾向《遠見》解釋,基於大陸法系背景,歐洲在方法論上傾向於從原則開始思考。先確立主要原則,再依此發展出更具體的指引。這與拒絕聯邦層級立法的美國、以及從實務應用面切入的新加坡相比,是相當不同的進路。(延伸閱讀:「去管制」不表示無監管,美國如何在AI競賽中取勝? )

然而,在面對人工智慧這類迅速演進的新興技術時,監管框架必須保持彈性,因應新議題進行調整。例如,在僅一年前,人工智慧代理能力方興未艾,卻可能在近期內加速進展。

再加上歐盟的民主價值觀,希望盡可能納入各方利害關係人一同討論,但同時也不能為了回應產業界反彈,而犧牲使用者權益。格賽爾表示,歐盟現在就是試圖透過AI法案及GDPR修正案因應調整現有框架,「在歐盟的體制背景下,我認為他們真的已經盡力了。」

深入比較及分析各國監管AI政策的格賽爾也提到,中國對生成式AI的相關立法相對密集,獨特之處是在國內重視政治穩定、在國際上追求領導AI發展與治理的野心。在監管AI的發展與應用時,持續削減對國外技術與供應鏈的依賴。

格賽爾認為,中國的監管模式相當聚焦於資訊,這包括AI生成的資訊,以及指令輸入的資訊,以確保在國內傳播的訊息不會影響到社會主義價值觀。她認為這是相當中國的模式,外部影響力不強。

企業合規路上,隱私、資料保護與透明度是不變核心

隨著全球監管環境持續碎片化,企業面臨龐大的法律不確定性。即使是大公司,也需要投注時間與資源來確認合規,中小企業以及新創的挑戰就更加艱巨。

格賽爾建議企業應特別關注隱私與資料保護。這包括訓練資料(預訓練及微調皆然),以及使用者輸入的資料。為使用者提供完善個資保障,是說服世界各地的使用者與企業採用產品的基礎。

透明度是另一項重要議題。現行的主流基礎模型有「黑盒子」之說,在AI模型內部運作不夠透明時,在其他面向提供盡可能的透明解釋,就成為差異化的契機。從模型訓練方式、部署方式,到處理安全事故的方式,都要盡可能地透明。

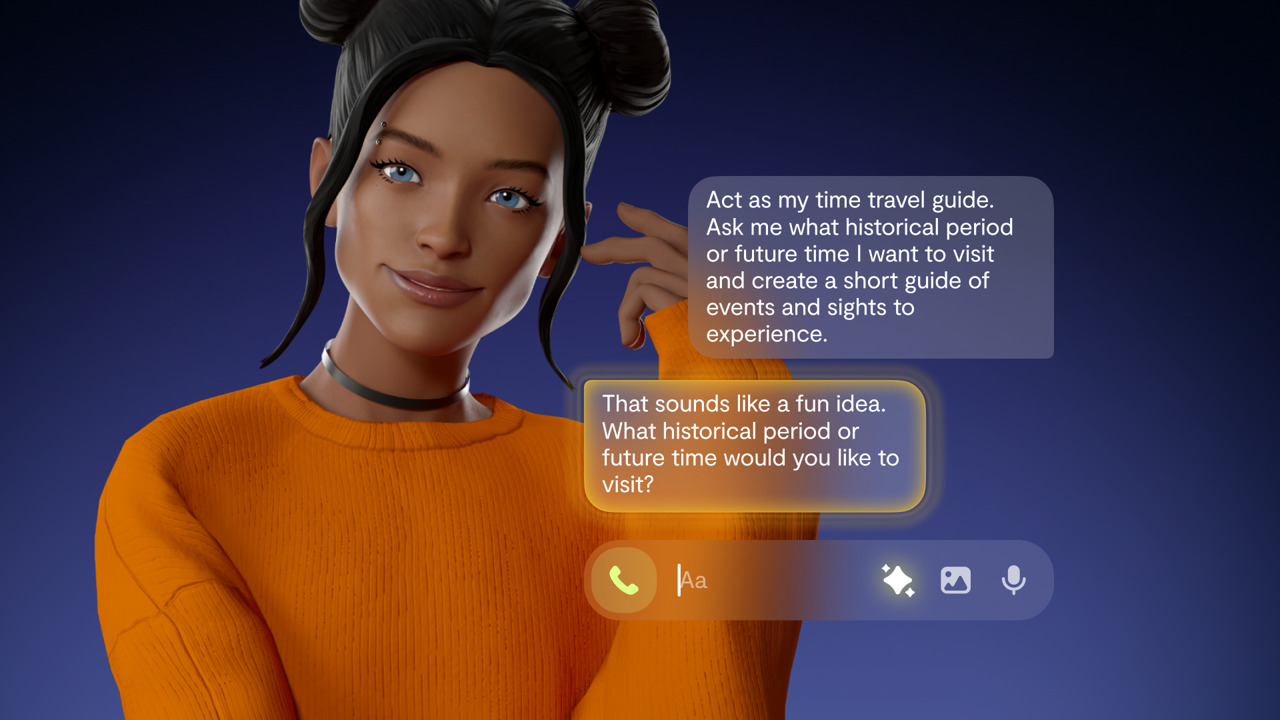

格賽爾觀察,隨著大眾逐漸習慣ChatGPT這樣的聊天機器人存在日常生活中,使用者使用這類AI工具的方式也出現的顯著的變化。過往,使用者對生成式AI的期望聚焦在生產力提升等工作任務,現已愈來愈常與ChatGPT討論心理、醫療等私人性的議題。

「在歐盟,被認為會操弄人類或操弄人類情感的AI工具是被禁止的。」格賽爾指出,「但我們需要界定其定義。」

格賽爾個人特別擔憂的是Replika這類利用使用者的孤獨感的「AI伴侶」應用,也承認這部份的監管尚不足夠。她指出,只要使用者願意披露,這類聊天機器人對使用者的理解,遠比過往追蹤使用者使用行為的社群平台更加深入、全面。

她擔心,若使用者輸入的指令資訊遭到濫用,這將是使用AI系統操弄人類想法的強大工具。例如,這可能被用於政治宣傳。

支持創新亦須監管框架,台灣需跟上國際腳步

主辦人工智慧與法律國際學術研討會的人工智慧法律國際研究基金會執行長張麗卿,亦向《遠見》指出,目前全球在AI治理與監管上有兩大趨勢浮現,值得特別關注。

一項是AI治理已從軟性勸導的倫理原則,逐步演進為具體、有罰則的法律,從歐盟AI法案到韓國的AI基本法,都是例證。

另一項趨勢是從沙盒試驗到落地實行間的程序與時間,有顯著的縮短。包括日本等地,只要人工智慧應用在試驗階段內沒有出現重大風險,就可以落地實行,簡化了企業從研發、實驗到落地新應用的速度。

在這兩大趨勢中,台灣仍處落後群列。不僅AI基本法仍未通關,沙盒實驗階段後的相關立法也尚未接應。為了扶育台灣AI生態系,張麗卿建議,應透過基本法鼓勵各主管機關修訂相關法規,並加強對中小企業的補助,進一步善用台灣既有的數據潛能。