身兼數學家與哲學家的法蘭西人文科學院院士丹尼爾.安德勒鑽研認知科學數十年,他如何看待人機互動的未來?當AI全面滲透人類工作及生活,為何「AI伴侶」令他格外擔憂?

ChatGPT、Gemini等流暢掌握人類語言的AI模型融入日常生活,不僅給與滿滿情緒價值,在經濟產值上也被寄予厚望。但伴隨而生的各種風險,也讓關注假資訊、情感倚賴與「大腦外包」的使用者敲響警鐘。

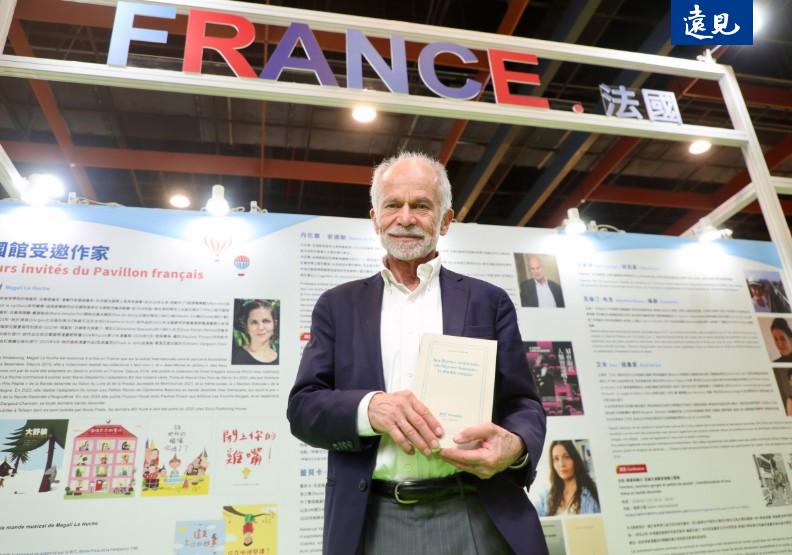

已思索人工智慧及人類智慧數十載的法國哲學家、法蘭西人文科學院院士丹尼爾·安德勒(Daniel Andler)日前訪台,宣傳2025年底出版繁體中文版的新書《AI會取代人類智慧嗎?人工智慧與人類智慧的雙重謎團》(Intelligence artificielle, intelligence humaine : la double énigme)。

79歲的安德勒擁有數學及哲學的跨領域學術背景,是法國認知科學發展的重要推手。在接受《遠見》專訪時,他指出,自己的職涯也可說是呼應人工智慧過往數十年的發展。

安德勒年輕時就對人工智慧研究感興趣,並對當時以符號、規則為基礎,在機器中重現人類智慧的進路抱持懷疑態度。他回顧,1970、1980年代時,人工智慧不是一個熱門議題。只有一小群學者熱衷於此,大部分的同業並不以為然。「許多人認為這行不通,確實也沒有成功。」他說,「這就是大家知道的AI寒冬。」

安德勒的研究精力轉向他後來深耕二十餘年、助力打造出學科架構的認知科學。這是相當合理的一步。畢竟,想讓機器模仿人類智慧,就得先對人類智慧的運作機制有更深入的了解。

直到深度學習架構有所突破,安德勒才重返AI研究。他表示,當模仿人腦神經元連結的神經網路進路崛起時,他已注意到這對認知科學研究深具意義。但當時受限於算力、資料等面向,神經網路模型未能發展出強大的智慧。直到深度神經網路模型「AlexNet」在ImageNet大規模視覺辨識競賽(ILSVR)奪冠,向大眾證明了神經網路的能耐,吸引更多人投入研發,後續也催生出Transformer的新架構。

不過,更多學者是到了2022年底ChatGPT發布時,才開始投入AI領域。「這產生了很大的變化。」安德勒觀察。一方面是大眾都能親自使用,且對成果印象深刻,AI熱度大幅提升。另一方面,不僅是科技、哲學領域,基礎科學、人類學、心理學等學門的專家們也湧入這個新興的辯論場域,討論深度隨之深化。

「我會說,這形成了一種人工智慧基礎的學術研究體系。」安德勒表示,「這是前所未有的。」

「AI伴侶」助長擬人投射,應以「處方箋」形式提供

現前這波AI熱潮受到生成式AI的大力推動。大語言模型(LLMs)能夠流暢掌握人類語言的能力,拉近了AI與大眾間的距離。但這也表示,大量不完全理解AI模型背後技術運作原理的使用者得以直接與模型頻繁互動,帶來情感倚賴、擬人投射的風險。

目前,已有不少新創推出提供情感陪伴功能的「AI伴侶」。即便是非經優化的通用模型,也傳出使用者產生情感投射,而在現實生活帶來負面影響的案例。再加上人形機器人的發展,這類擁有高度互動能力的模型也將擁有在實體世界的「身體」。

這些發展,都令安德勒十分憂心。「如果我有權力可以按下一個按鈕,就禁止AI伴侶,我會這麼做。」他直言,「這太危險了。」

安德勒認為,AI伴侶容易引導人們對不真的在乎自己的AI系統產生依戀感,但這並不表示在任何情況下都不得放行AI伴侶與人類互動。他舉例,就像許多人可以從閱讀喜愛的書籍中獲得情感慰藉,倘若能不對AI系統產生擬人投射,也可功能性地獲益於AI生成的情感價值。

他比喻,有如以「處方藥」而非「成藥」的形式,只在合格治療師評估的安全範圍內,才「開立」AI伴侶作為情感支援服務。

真正理解人工智慧,需發展新的概念體系

廣義地說,人類需要在先進人工智慧造成前所未見的危害前,學會如何與AI共存。而這有賴於對人工智慧有更準確的理解。至今,人類鬆散地使用自己發展出的語言描繪人工智慧的運作,但並不總是足夠精準。

例如,近來研究者愈發重視AI系統應有「持續學習」的能力。但安德勒指出,AI模型(目前)並不真的像人類那樣「學習」。人類可以在既有的知識基礎上習得新的知識與技能,而AI模型比較像是因應新的資料數據產生改變。在調整模型權重的過程中,可能因此完全失去過往學到的技能。

即使是「理解」這樣基礎的能力,也存在著語言無法精準指涉的模糊地帶。一個大語言模型究竟是否理解自己輸出的內容?學者對這個看似單純的問題莫衷一是。

美國語言學教授本德(Emily M. Bender)等人在2021年提出「隨機鸚鵡(stochastic parrot)」的比喻,認為大語言模型只是根據語言序列形式,統計性地模仿人類產出的文本,不真的理解其中含義。

然而,有「深度學習教父」之稱的電腦科學家辛頓(Geoffrey Hinton)認為,大語言模型能夠如此切合地回應提問指令,顯然具有理解的能力。安德勒舉例,如果我們問某個人如何前往捷運站,而這個人回答出整套路徑,我們就會認為他是「理解」的。

安德勒指出,就現況來說,本德與辛頓的看法都可以說是對的。「我想說的是,我們缺乏適當的概念(去討論大語言模型)。」他表示,我們需要另一種「理解」的概念,既不是完全不理解,也不是人與人之間的那種理解,「而是介於兩者間的某種概念,我們需要去發明或探索那是什麼。」

人機協作如何改變思考模式?有待時間驗證

關於人類頻繁與AI系統互動,可能因「大腦外包」改變認知與思考模式的擔憂,安德勒承認,目前沒有看見太多研究論文精準探討相關影響。他認為,自ChatGPT問世至今只過了三年,還不足以產生根本上的變化。

安德勒的推測是,諸如因果推理這類基本認知能力,是經過漫長的天擇演化而來,不會這麼容易改變。但其他較表層的思考習慣可能因為與機器密切互動而變化。

另外,這也因個人使用方式而異。安德勒自陳只是輕度AI使用者,主要用來搜尋自己知道、但因時光久遠無法完整記憶的內容,例如多年前曾經讀過的哲學家論證。對他來說,AI可能改變了工作流,但未影響他深度思考的過程。最終,AI對人類思考方式的影響還需經驗實證。

AI對整體社會的影響,可能也只能等待時間驗證。科技樂觀主義者認為,人工智慧可將人類文明推入另一層境界,疾病可被治癒,能源可被更永續地開發、使用。但對於先進模型取代人類勞工、升級戰爭形態的擔憂也在惡化。

難以辯駁的現況是,人工智慧的高速競賽以及主流論述,大體上由少數國家的科技巨頭支配。對此,哲學家可以且應當扮演什麼樣的角色?安德勒的回答,令人想起《蘇菲的世界》(Sofies verden)中的比喻:這世界就像魔術師從他的帽子裡拉出的一隻白兔,人類則是寄居在兔子毛皮深處的微生物。

哲學家們是一群沿著兔子的細毛往上爬,想把魔術師看個清楚的人。他們努力攀附在脆弱的兔毛頂端,朝窩在舒適柔軟的兔毛深處的同胞大聲呼叫,描述自己發現的事物。

安德勒指出,從財富規模到政治影響力,當前少數科技巨頭匯聚了過大的權力,「哲學家可以做的事,是盡可能地讓更多人意識到這其中的利害關係,以及這有多麼嚴肅。」