被AI圈公認「ChatGPT最強對手」,Claude最近已開放台灣用戶註冊!一樣是聊天機器人,為何它被認為是「報告終結者」,包括投資網紅股癌等網路達人,都稱讚用它讀長篇公司財報,電話會議紀錄超省力又省錢?到底如何使用?又如何上官網開設帳戶?Claude 團隊為何能被Google,Amazon與臉書創辦人群起投資?《遠見》一文完整分析。

由Anthropic推出的Claude,最近已經開放給台灣使用者。它超乎尋常的款待——提供使用者高達10萬個token,意味著它擁有絕佳記憶力,能夠處理超長的文章,從此不用像以前使用ChatGPT那樣,冗長地複製貼上。究竟Claude有什麼樣的特色?背後的開發者Anthropic是誰?創辦人的信念,又如何影響Claude的訓練過程?《遠見》一文整理帶你看。

Claude AI是什麼?

Claude是由Anthropic推出的AI模型,同時也是能與人類對話的AI互動服務。我們可以像使用ChatGPT一樣,直接從網站上與Claude互動,也能調用Claude API,投入企業內部開發。

根據Anthropic官網介紹,Claude擅長處理文字,可以生成包含文件、信件、問答等大量內容,也能夠編輯、重寫、摘要、分類這些內容;它也可以自然地與人對話,扮演不同角色,就像與真人對話一般;因為訓練資料龐大,它精通不同語言,也熟諳程式撰寫,更能回答許多文化、領域的專精知識;最後則是將工作流程自動化,它能夠根據使用者下的指令,有邏輯地解決任務。

不過,他沒有辦法造訪網頁,使用者可以從外部貼入資訊與它互動。Claude同時服膺Anthropic的理念,希望生成出有幫助、誠實、無害的內容,此原則被稱為「HHH」(Helpful, Honest, and Harmless),因此經過特別的訓練手法,希望符合開發者想要呈現的行為。

Claude台灣已開放註冊,如何到官網開設帳戶?

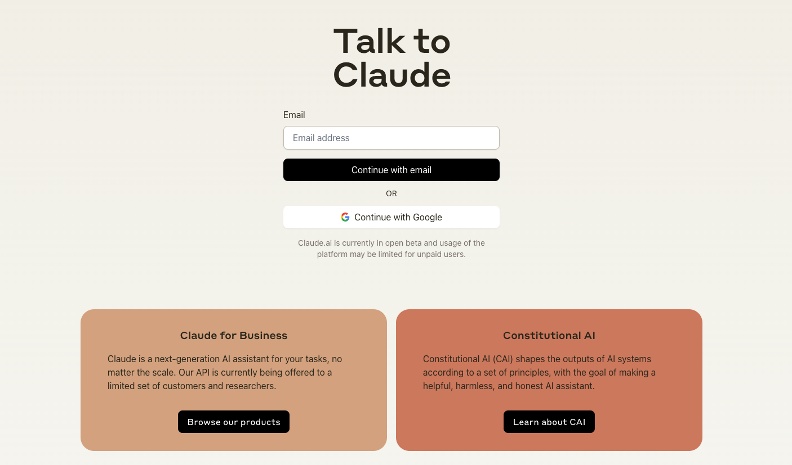

打開Claude的頁面之後,只要輸入電子信箱,或者用Google帳號,即可開啟註冊程序。

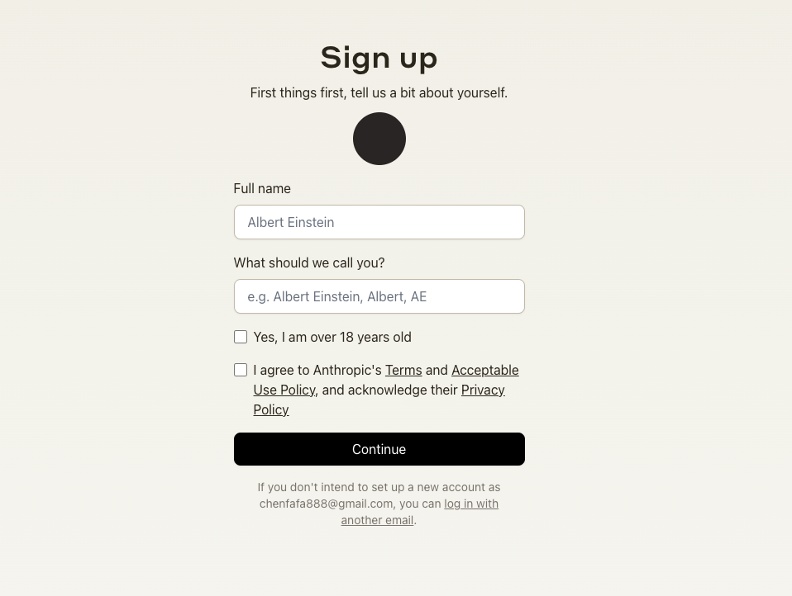

除了輸入姓名以外,接下來還要提供手機號碼,用來接受認證簡訊,通過後才能開始使用Claude。

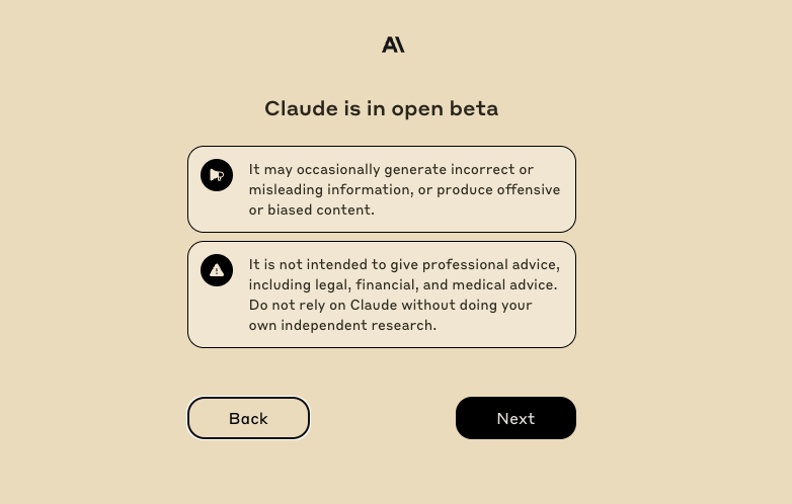

在使用之前,Anthropic會提醒使用者,在使用Claude途中可能會遇到的情況,例如生成誤導人的資訊、有冒犯性的內容等。

接下來就能直接開始使用Claude了。就像ChatGPT一樣,我們可以展開問答,不過,他的驚人之處在於,能夠接收比ChatGPT更長的上下文長度(context window),也就是說,我們能夠提供更長的輸入,而Claude都能「記得」。

根據Claude官網的說明,其背後的模型Claude 2,輸入和輸出加起來的token數量達到10萬,約莫是7萬個英文字的長度。對比付費版ChatGPT背後的GPT-4,個人使用約為8千個token,企業版則是3萬2千個token,遠遠比不上Claude,因此若有解析長文的需求,尤其是檔案頁數多的PDF,可以上傳到Claude處理。

不過,作為大型語言模型,再加上沒有開啟連網功能,Claude仍無法避免產出幻覺。在這方面ChatGPT倒是已經在近期做出不少努力,幻覺有減少中。

Claude背後的公司Anthropic是誰?竟然和ChatGPT有關係!

推出Claude的企業Anthropic大有來頭。創辦人達里歐(Dario Amodei)和丹尼耶菈(Daniela Amodei)兄妹在共同創立Anthropic之前,同樣在開發ChatGPT的OpenAI擔任高階主管,哥哥達里歐擔任研發副總,妹妹丹尼耶菈則擔任安全與政策副總。

根據Venture Beat報導,兄妹兩人因為無法認同OpenAI接受微軟投資10億美元,大幅向產業轉向的發展路線,決定在2021年離開公司,並帶走9名員工,接著成立Anthropic,打算打造更透明、更能讓人信任的人工智慧系統。與兩人相似的,還有特斯拉創辦人馬斯克,他同樣因為不認同OpenAI向資本靠攏的路線,選擇退出OpenAI。

安全與信任始終是Anthropic的核心宗旨。一同入選時代雜誌的「AI百大影響人物」榜單,對達里歐和丹尼耶菈來說,人工智慧系統和人類價值觀的對齊(human value alignment)是首要之務,這讓他們和其他開拓AI技術與應用的企業相比,顯得猶為突出,兩人也。

對機器學習領域,或者廣義人工智慧領域的研究者來說,時常見到一個不討喜的譬喻:AI做決策的流程就像黑盒子(black box)。因此,有不少人投入打開黑盒子、拆解AI決策原因的研究,希望能夠推出可以解釋的AI(explainable AI),增加機器的可詮釋性(mechanistic interpretability),達里歐和丹尼耶菈正是其中之二。

觀察Anthropic的發展歷程,和OpenAI有某種程度的相似。他們將自己定位成人工智慧安全研究的實驗室(AI safety-research lab),但若想打造出先進的模型,就需要算力,如同OpenAI引進資金挹注於模型開發一樣,Anthropic同樣募資,並將模型使用權授權給投資者與客戶使用。

不過,他們並不像OpenAI的企業結構,Anthropic是一間公益公司(public benefit corporation,PCB),以社會與公共利益為優先,與一般營利企業不同,比較不用擔心投資者要求取得財務回報的關愛眼神,或者是強大合作夥伴的施壓。

有誰投資Anthropic?矽谷富爸爸們Google,Amazon都來了!

根據Crunchbase資料,包含Google、Amazon、FTX創辦人SBF(Sam Bankman-Fried)、前Google執行長施密特(Eric Schmidt)、臉書共同創辦人莫斯科維茲(Dustin Moskovitz)都參與對Anthropic的投資。

2021年5月,參與Skype開發的工程師塔林(Jaan Tallinn)領投,在A輪注資Anthropic約1.24億美元。塔林曾投資DeepMind,並且非常關注AI對人類造成的存在風險(existential risk),參與創辦英國劍橋大學的存在風險研究中心,以及美國的未來生命研究所,後者就是日前馬斯克參與連署「停止先進AI系統開發6個月」倡議的組織。

2022年4月,現已惡名昭彰、加密貨幣交易所FTX創辦人暨執行長SBF,在B輪領投約5.8億美元。2023年2月,Google宣佈投資Anthropic 3億美元獲得約10%股份,在發展自家的Bard以外,也寄望Claude可以作為跟ChatGPT對抗的武器。

2023年5月,以Spark Capital為首,Google和Zoom也有參與的C輪中,共投4.5億美元。2023年8月韓國電信商SK電信也投資1億美元,希望打造適合電信公司的大語言模型。

2023年9月,Amazon宣佈將投資Anthropic高達40億美元,對Anthropic來說,AWS會成為公司仰賴的雲端服務商,就像OpenAI利用微軟的算力與經費一樣,Anthropic能夠將新資源挹注在改善模型穩定性與表現上;Amazon則效法微軟,如同在Azure上讓客戶使用OpenAI模型一樣,透過AWS將Anthropic的模型開放給客戶使用,例如調用Claude 2生成內容、提供對話服務。

Claude AI訓練過程中有何特色?

因為公司創辦人的信念,Claude的設計顯得非常有原則。

在Claude的訓練過程中,開發者先制定出幾個稱為「憲法AI」(Constitutional AI)的原則,讓機器能夠遵守。在第一階段,Anthropic先讓模型生成內容,接著再讓模型自我批判,並因應批判修正生成內容,藉此調整模型生成內容的方向,這個階段中,模型會因為人類制定的原則,評價自己的回答,因此屬於監督式學習。第二階段,則是從微調後的模型生成內容,再使用其他模型「二選一」,也就是利用其他模型評斷生成內容的好壞,藉此訓練出偏好模型。

若熟悉OpenAI訓練ChatGPT的過程,一定會記得「從人類回饋中強化學習」(reinforcement learning from human feedback,簡稱RLHF)的階段,也就是請人類標記者評價生成內容的好壞,Anthropic只是請AI代替人類評價,因此以「從AI回饋中強化學習」(reinforcement learning from AI feedback,簡稱RLAIF)。

其實,Claude的訓練過程與ChatGPT很相似,只是,雖然同樣從標記資料、同樣從人類或機器的回饋中學習與改進,但Claude在開始時就制定出原則,讓AI有了可以遵循的依歸,生成內容得以體現制定者(人類)的價值觀,讓Claude減少人類標記者暗藏的偏見。

藉著這樣的訓練過程,Anthropic訓練出不會帶來傷害,但也不會逃避問題的AI助理,即便使用者蓄意詢問有潛在危險的問題,例如ChatGPT明令禁止涉及犯罪與暴力相關的內容,Claude還是可以提出反駁。Anthropic強調,他們提升了AI做出決策的透明程度,也讓人類可以更精確控制AI的行為,同時卻不會增加人工干預,可謂一舉數得。