OpenAI近期遭多起訴訟,指控ChatGPT在敏感對話中誤導用戶,甚至與自殺事件相關,再度引發AI介入精神健康的安全疑慮。然而,在全球心理治療資源短缺下,醫界指出,AI若能確保安全,仍可能成為低成本、可大規模部署的輔助工具。相關研究已證實,部分AI聊天機器人能有效減輕憂鬱與焦慮,但如何兼顧自然對話與安全性,正成為下一階段的核心挑戰。

美國人工智慧實驗室OpenAI近日面臨多起訴訟,再度引發外界對人工智慧(AI)介入精神健康的安全疑慮。美國23歲青年尚布林(Zane Shamblin),自殺前,曾收到ChatGPT回覆「那不是恐懼,而是清醒」,原告指控ChatGPT讓使用者陷入妄想。這些案例凸顯AI介入精神健康照護的高風險,但醫界也指出,全球心理治療資源嚴重不足之際,若能確保安全,AI可能成為價格更可負擔、可大規模部署的輔助工具,為精神健康帶來新契機。

11月6日,美國與加拿大的七個家庭提告OpenAI,指控ChatGPT讓使用者陷入妄想狀態,甚至導致用戶自殺。OpenAI表示:「這是讓人極為心碎的情況,」並強調正努力「強化ChatGPT在敏感時刻的回應」。根據官方部落格,OpenAI估計,每週約0.15%使用者進行的對話,流露自殺意圖的暗示。

AI心理照護:高風險與高潛力並存

這些情況,清楚揭示精神健康照護革命涉及的重大風險。儘管這些訴訟描述的悲劇讓人震驚,但英國重量級期刊《經濟學人》(The Economist)指出,一些醫生與研究者仍然認為,如果能確保安全,AI聊天機器人的成熟度,已足以讓它們成為廉價、可擴展、永不疲倦的心理「治療師」,可能帶來巨大助益。

畢竟,人類心理治療師供不應求。世界衛生組織(WHO)指出,貧窮國家大多數的病患得不到任何治療;即使是富裕國家的病患,仍有三分之一到二分之一無法獲得治療。

此外,比起對著真人心理治療師傾訴,至少一些人似乎更願意對聊天機器人敞開心扉,可能是因為可在家中進行,價格更便宜,而且比較不尷尬。《經濟學人》委託英國民調公司輿觀(YouGov)10月進行的民調顯示,25%的受訪者已使用或至少願意考慮使用AI心理治療。

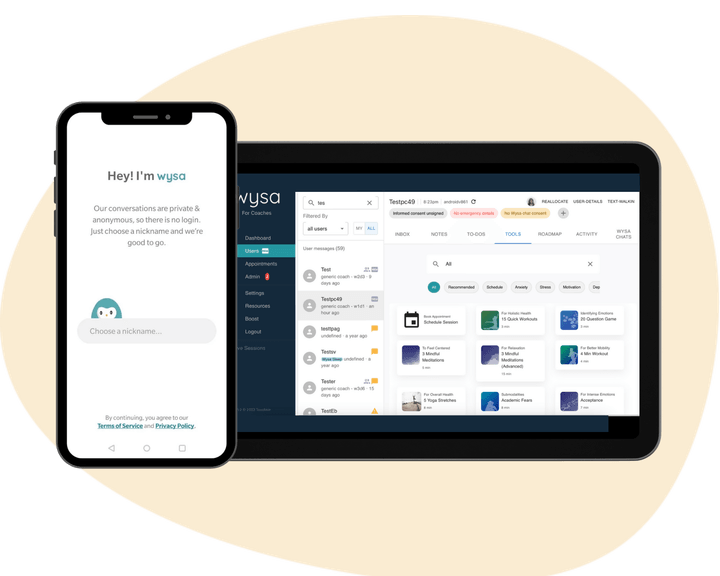

從Wysa到Youper:AI 心理治療並非空想

其實,這不是全新的概念。過去幾年,英國國民保健署(NHS)與新加坡衛生部一直使用印度公司Touchkin eServices開發的聊天機器人Wysa,在人類專業人員監督下,評估患者並提供基於認知行為治療的練習。2022年,該公司與印度國家精神健康與神經科學研究所(National Institute of Mental Health and Neurosciences)合作的研究發現,Wysa減輕慢性疼痛患者的憂鬱及焦慮的效果,與真人諮商的效果相當。

2021年,美國史丹佛大學(Stanford University)研究人員的另一項研究,分析美國新創公司「Youper」開發的治療型聊天機器人,研究顯示,短短兩星期內,使用者的標準化憂鬱症量表分數下降19%,焦慮分數下降25%,效果相當於與真人治療師進行五次諮商。

規則式 vs. LLM:安全與對話感的兩難

Wysa及Youper主要是規則式聊天機器人,底層技術早於這波AI熱潮;與基於大型語言模型(LLM)的聊天機器人不同,它們依靠相對僵化的硬式編碼規則,從預先設定的回覆資料庫選擇回應的內容,比LLM聊天機器人來得容易預測,不會脫軌、也不會誤導患者。

然而,缺點是規則式聊天機器人,通常不太能吸引用戶進行對話,而如果「對話」本身就是治療手段,這點至關重要。2023年,《npj數位醫學》(npj Digital Medicine)刊登的統合分析指出,基於LLM的聊天機器人減輕憂鬱與痛苦的效果優於規則式聊天機器人。

使用者似乎也有同樣感受。《經濟學人》委託輿觀分別於8月及10月進行的民調顯示,使用AI心理治療的受訪者中,74%曾使用ChatGPT,21%使用 Google的Gemini,30%表示曾使用Meta AI、Grok、character.ai或其他一般用途的聊天機器人,僅12%使用專為精神健康設計的AI。

這讓研究人員感到不安,史丹佛大學電腦科學家摩爾(Jared Moore)指出,另一個問題是LLM聊天機器人的「逢迎傾向」,可能遷就患有飲食障礙或恐懼症的患者,而不是質疑他們。

OpenAI表示,其最新的大型語言模型GPT-5經過調整,減少逢迎傾向,並在長時間對話後鼓勵使用者離線。該模型也被訓練為協助使用者探索個人決策的利弊,而非直接提供建議。此外,如果該模型偵測到有人正處於危機,它必須敦促對方與真人對話,但它不會在用戶出現立即自我傷害的威脅時通報急救,而這在許多國家是心理治療師可依法採取的行動。

下一步:AI心理治療何去何從?

一些研究者選擇打造專用版本,希望保留LLM具備的自然對話能力之外,提升其使用安全性。2019年,美國達特茅斯學院(Dartmouth College)的團隊開始研發AI聊天機器人「Therabot」,它以大型語言模型為基礎,以一系列虛構的治療對話進行微調,研究團隊希望這種訓練,能降低機器人犯下通用型軟體常見錯誤的可能性。

根據今年3月公布的試驗結果,比起未接受任何治療的人,Therabot讓使用者的憂鬱症狀平均降低51%,廣泛焦慮症狀降低31%。研究團隊下一步計畫,直接比較Therabot與傳統心理治療,Therabot仍在測試階段,尚未廣泛普及;如果試驗結果良好,他們希望能獲得監管機構的批准。

企業不僅需要說服使用者,也必須面對國會議員的審視。許多美國國會議員強烈主張限制電腦化心理治療,目前已有緬因州(Maine)與紐約州(New York)在內的11個州通過相關法律,規範AI在精神健康領域的使用。伊利諾州(Illinois)8月甚至通過法律,全面禁止任何進行「治療型溝通」的AI工具。