當有微軟強力投資的ChatGPT稱雄今年人工智慧新風潮,來自Meta的AI專家楊立昆卻在近日北京論壇上直言,5年內再也沒有人會使用驅動ChatGPT的大語言模型,因為它很快就要被淘汰了。楊此言是純粹想貶低同業,還是另有觀察?他提出將取而代之的世界模型又是什麼?

6月初,中國大陸一場「人工智慧安全與對齊」為題的論壇上,盛大邀請了AI界搖滾巨星,Meta副總暨首席AI科學家楊立昆(Yann LeCun)一同線上參與,北京現場仍座無虛席,宛若集體收看演場會直播。

但,雖然OpenAI領軍開發的ChatGPT去年橫空出世,至今其背後的GPT自迴歸語言模型(Autoregressive Language Model),仍占據生成式AI領域明星地位,楊立昆卻不以為然。當場他指出,5年內這類模型就不會有人想使用。到底他的說法純粹是貶低同業,還是真有道理?

楊立昆:「5年內不會有正常人,繼續用目前流行模型」

首先,早在論壇之前,過去幾年楊立昆便數次強調,人工智慧無法和動物相比,因為後者有著觀察學習能力,但AI人工智慧遇上新任務就要重新開始。

這場論壇分享中,楊立昆重申立場後,隨後做出更多補充。他指出如GPT這類當下流行的自迴歸大語言模型,無法擁有推理和規劃能力,因為它只是拆散後重新組織,自然也沒有學到關於真實世界的知識,「這些系統沒有物理世界經驗。」他強調。

究其根本,人類和動物能夠透過觀察和反覆嘗試,掌握世界運行規律,例如嬰兒在成長過程中能夠理解有重力運作著;即使機器反應速度很快,但它無法像青少年在數十個小時內學會開車,也沒辦法完成洗碗與清理餐桌任務。

遇到新問題或者新情境時,一切訓練都要重來,人工智慧始終無法克服此問題,楊立昆表示,顯然人工智慧還缺乏某些要素。

楊立昆也用人類的演講規劃來比喻,演講前我們總會事先規劃(planning)架構大綱,決定每一句說出去的台詞之間如何連貫,通常事前準備時,我們會以列點方式來進行整理。但是這樣的作法,和ChatGPT背後的GPT模型可不一樣。所謂自迴歸大語言模型的特點,是如玩文字接龍,你問,他試著接相對應的答案,可不是有架構列出大綱,所以GPT這種「逐字逐句」的生成模式,其實毫無推理可言。但他個人認為,在傳遞事實與知識上,推理與規劃當然是有其必要性。換言之,ChatGPT背後模型,終將被淘汰。

因此,楊立昆大膽預測,「5年內沒有心智正常者(in their right mind)還會使用自回歸的大語言模型,它們會迅速地遭到拋棄。」

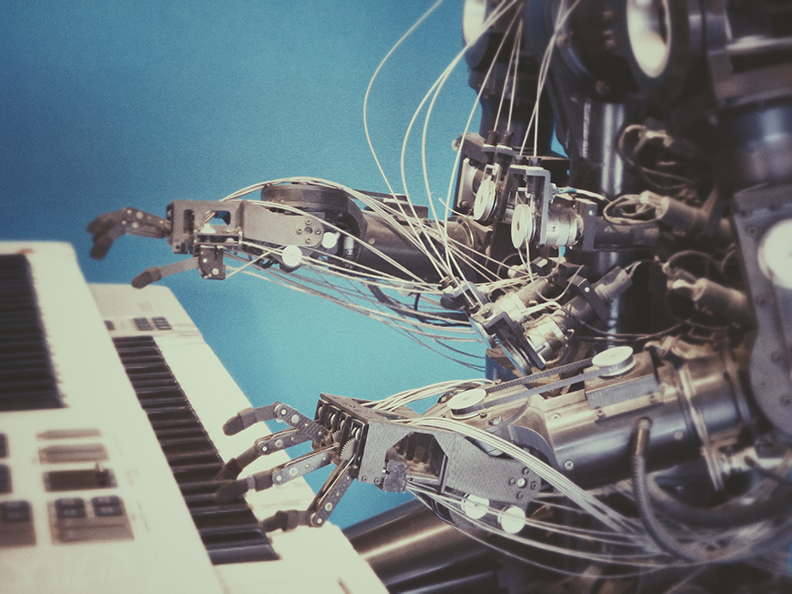

世界模型,才能讓AI機器像人類一樣思考

那麼,究竟該怎麼做,才能「讓機器像人類一樣思考?」楊立昆提出一個全新解方:世界模型。

抽象地說,世界模型關於「想像未來將會發生什麼」,類似大腦分拆任務,模型將會預測每個行動的相應後果,考量成本後,改善行動序列,並找出最佳選項。

楊立昆拆解出兩種系統,他引用《快思慢想》中系統一和系統二說法(前者偏向感性、直覺、本能,後者更重邏輯、規劃、深思),世界模型中,模式一將會感知外界運作,並直截了當地產出對應行動,模式二則觀察外部後,勾勒出連串序列,接著搜索成本最低的行動序列,再依此行動,此過程中涉及邏輯與推理,也會考慮模型開發者預先設立的目標函數與成本。

實務來看,世界模型訓練機制和自迴歸模型機制不同。事實上,楊立昆演講後,Meta已經提出新模型I-JEPA,運作模式更像抽象思考,而非隨機接答案。用楊立昆的話來說,自迴歸模型訓練與預測發生在最小單位的字句之間,而世界模型則是在高維度抽象空間,嘗試理解物體之間關聯,因此圖像上能學到「大局」,較不會出現硬是要拼湊,因而產生不合理內容。例如,Midjourney等算圖工具常在生成人像時,出現為人詬病的「第六隻手指」。

微軟與OpenAI合作,Meta則有楊立昆坐鎮,雙方人馬走上不同道路,技術之爭愈打愈烈。ChatGPT確實缺點不少,但是稱頌好用的人更多,是否真如楊所言,這類自迴歸大語言模型會迅速遭到淘汰?就等時間觀察。