聯發科(2454)近期因法說會上Google TPU商機報喜,8日股價已漲至3630元,成為本週話題最熱股,更令人好奇它下一步發展在哪裡?走進位於苗栗銅鑼的聯發科研發資料中心,映入眼簾是一座聯發科專為AI時代打造的高密度算力基地。這裡不只是支撐聯發科AI模型訓練與高階晶片開發的核心後盾,更是推動5奈米、3奈米先進晶片研發的重要運算心臟。此次,聯發科首度對外揭開這座AI資料中心的神秘面紗,就讓《遠見》記者帶領讀者,讓大家一窺台灣IC設計龍頭如何在AI算力競賽中,打造自己的最強算力基地。

「歡迎蒞臨聯發科技銅鑼研發資料中心,接下來將由我擔任嚮導,請跟隨我的移動路線。」一台車身貼有 MediaTek 標誌的自主移動機器人(AMR),一說完這段話,隨即緩緩移動帶領媒體記者進入聯發科 AI 機房參觀。

別小看這台AMR。根據聯發科介紹,這台機器人已與整座資料中心的門禁與電梯系統完成整合,能自動呼叫門禁、開啟通道;機身上方搭載的 360 度環景攝影機,也可即時拍攝整個行經路線與現場狀況。

聯發科指出,透過這套系統,遠在約40分鐘車程外的新竹總部工程師,即使不必親自前往資料中心,也能遠端監控與協助設備維修,預估每年可節省超過1000小時的維運人力。

1380億Tokens幕後功臣:聯發科GPU AI機房

跟著這台AMR機器人的腳步,第一站來到的是聯發科採用輝達(NVIDIA)B200 Blackwell SuperPod平台、搭配氣冷散熱設計的AI機房。

打開厚重機房大門,映入眼簾的是一整排排列整齊的高密度機櫃。走近其中一座機櫃,可以看到內部兩片金黃色的大型GPU板卡相當顯眼;而鄰近機櫃之間,則布滿一條條粗大的青藍色高速線纜,負責串聯不同GPU節點,形成龐大的 AI 運算網路。

別小看這看似不大的空間。聯發科指出,這座GPU高效能運算機房,主要負責AI模型訓練與推論,支援公司內部AI算力需求以及高階晶片開發。整體平台以NVIDIA DGX系統為核心,採用第四代SuperPod架構,並透過高速網路把所有GPU節點串聯起來,形成一個大型GPU運算池。

聯發科資訊工程本部全球資訊服務副處長黃博揚透露,目前這座機房每月需支撐高達1380億Tokens的運算需求,並完成超過2.4萬次模型訓練,堪稱聯發科AI晶片與先進製程研發背後的重要算力心臟。

黃博揚進一步表示,若回頭對照聯發科先前與NVIDIA共同發布的AI算力資訊,其實就能看出成長速度之快。「去年底我們公布的AI算力規模大約是600億Tokens,但現在已經來到1380 億Tokens。」短短不到半年時間,AI 算力需求便呈現倍數成長,也反映整體 AI 運算需求正快速擴張。

把伺服器泡進液體 下一站:浸沒式液冷機房

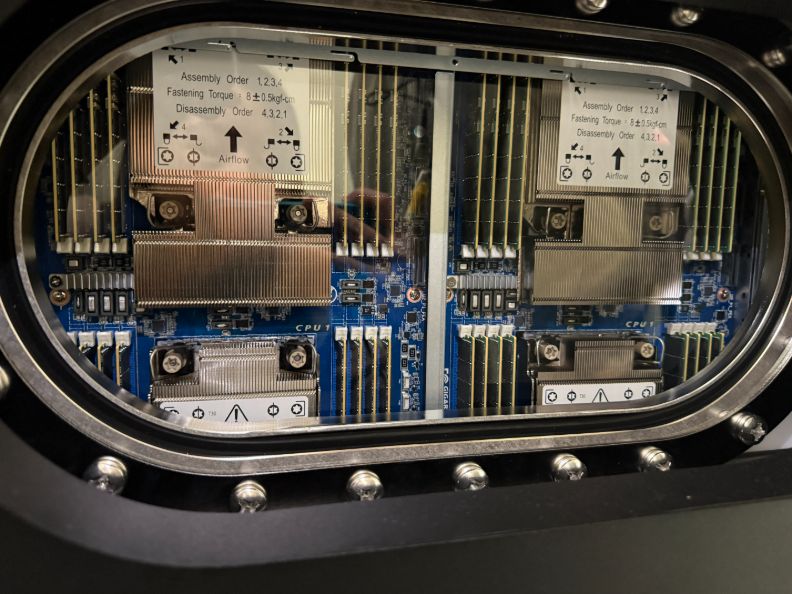

離開氣冷GPU機房後,聯發科接著帶領媒體來到另一個更神秘的區域,由CPU組成的浸沒式液冷高效能運算機房。

和傳統機房最大的不同在於,這裡的伺服器不是靠空氣散熱,而是整台直接浸泡在特殊的不導電冷卻液中運作。聯發科指出,相較於傳統氣冷架構,浸沒式液冷更適合高密度、高耗能AI運算環境,能有效提升散熱效率與能源使用效率。

現場可以看到,一台台黑色液冷槽採上掀式設計,打開上蓋後,內部伺服器便完全浸泡在冷卻液中。當系統開始運轉時,晶片產生的熱能會直接傳導到冷卻液內,受熱後的液體因密度下降自然上浮,再透過後端冷卻液分配單元(CDU)行熱交換,形成完整循環。

機櫃外部則配置獨立操作面板,可即時監控配電單元(PDU)、幫浦與溫度等各項運作數值。其中,液冷幫浦負責將攜帶熱能的冷卻液打向後方CDU,而後方一整排封閉式水路系統,則會將常溫水導入CDU,再把熱能送回外部冷卻水塔,完成整體散熱循環。

聯發科也透露,這套浸沒式液冷系統最大的目的,就是因應AI時代下快速飆升的算力密度與耗電需求。在GPU、CPU功耗持續攀升下,未來資料中心除了比算力,散熱與能源效率也將成為關鍵競爭力。

AI變化太快 聯發科算力布局保留彈性

目前聯發科在銅鑼的資料中心第一期已經正式啟用。而針對後續該資料中心的電力規模、GPU採購策略的計畫問題,黃博揚則回應,聯發科目前資料中心規劃共分三期建置,「第一期是15MW(megawatt),每一期規模都相同,所以三期總計就是45MW。」

而對於外界關注是否會導入自研GPU或其他AI晶片架構在這座資料中心內,他則坦言,目前公司並未自研GPU,而是持續採取開放評估策略。

他指出,AI產業變化速度極快,「兩年前買的GPU,現在可能只能支援非常舊的模型。」因此,公司在評估新平台時,必須同時考量不同架構,包括GPU、TPU,以及其他AI加速方案是否適合目前研發團隊的工作負載(workload)、資料流(data flow)與訓練模式。

他坦言,現階段TPU在部分運算模型與應用場景上,「還不是我們目前的首選」,但未來是否會改變仍保留彈性。

「目前我們投資的是B200 Blackwell平台,因為它最能支援現階段專案、RD工作負載,以及現在模型訓練需求。」他說。