身為輝達實現美國製造的好伙伴鴻海,已經培育出赴美的「首腦」?7月底正式開源的繁中基礎模型FoxBrain,也早已成為鴻海2025年新亮相的AI護理協作機器人「Nurabot」的大腦。但鴻海研究院腳步不停,下一步將研發「視覺-語言-行動」(VLA)模型,為何這是開展機器人應用的關鍵環節?鴻海研究院人工智慧研究所所長栗永徽補充,FoxBrain,除了成為鴻海在台灣打造三大智慧平台的重要基礎,國外布局也是「未來的大方向」。

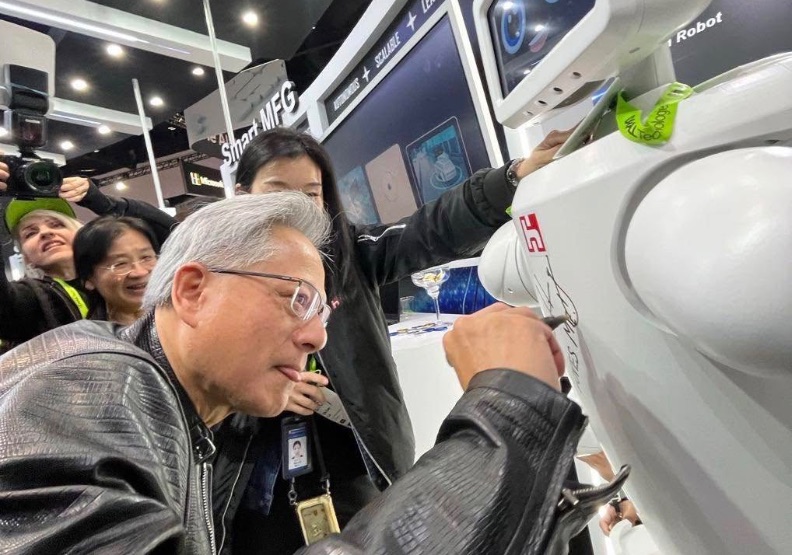

輝達黃仁勳向川普承諾的美國製造願景中,鴻海為主要合作伙伴,許多線索已經浮現。但是鴻海該如何實現黃仁勳口中的「智慧製造」?這或許是答案。

鴻海(2317)3月宣布推出全球第一個繁體中文訓練的大型語言模型「FoxBrain」,加值董事長劉揚偉所提及的三大平台,即智慧製造、智慧電動車、智慧城市,成為鴻海拓展不同領域的最強大腦。

鴻海研究院人工智慧研究所所長栗永徽在AI WAVE演講中宣布,7月31日,FoxBrain在Hugging Face上完成開源,供學研使用。當前開源版本其實是1.2版,因為經過內部測試後,團隊熬夜趕工修正,成功在7月底上架。宣布完這個好消息,他臉上神色難掩笑意。

栗永徽進一步說明,FoxBrain在訓練過程中融入台灣語境資料,提升本地常識表現,並在微調階段加入工業、製造業的垂直領域知識,也加入加入推理能力。如此一來,FoxBrain不僅懂台灣用語,更懂台灣的製造業。

接受《遠見》專訪時表示,他期望FoxBrain不僅可為台灣主權AI提供基礎,也能成為一個「工業應用界的通用模型」。

美國工廠自動化比例高,鴻海靠智慧製造基礎模型因應

簡單來說,在面對工業領域的各種事件時,FoxBrain可以比市面上的其他模型「更快進入狀況」。例如,同樣輸入一張PCB板的影像,製造業知識更深厚的FoxBrain可以比其他模型更快、更精準地辨識元件是否有瑕疵、焊點是否有失誤等。

這也能為進一步的任務細化,提供一個更堅實的起步點。這在擴張美國廠區的計畫中,尤其彌足珍貴。他進一步補充,FoxBrain除了成為鴻海在台灣打造三大智慧平台的重要基礎,國外布局也是「未來的大方向」。

栗永徽解釋,考量美國人力成本,工廠自動化比例必須更高。但一條產線上可能有幾百項不同任務,要為每一項任務獨立訓練模型,相當曠時費力。如果FoxBrain這樣的智慧製造基礎模型表現得宜,可能只需再加以少量微調,就能快速學會特定任務,有助於加速自動化工廠的大規模機器部署。

除了成為橫跨多產線的通用平台,FoxBrain身為「鴻海最強製造業大腦」,部署的機器人也有望包含多種類型,機械手臂、輪型機器人、人型機器人都有可能,「對我們來說,它們都是一種生產工具,外型並不是那麼重要。」

尤其,近期鴻海傳出在休士頓的廠房已部署人形機器人,也與美國物流機器人公司Robust AI展開合作,未來發展耐人尋味。

不只製造業大腦,Foxbrain也助攻鴻海護理機器人

其中一項FoxBrain部署於機器人的案例,場景則是在智慧醫院,2025年5月GTC Taipei首度在台灣亮相、由鴻海與台中台中榮民總醫院、川崎重工協力打造的AI護理協作機器人「Nurabot」。

Nurabot 搭載 FoxBrain 大型語言模型,支援文字轉語音、語音辨識、自然語言處理等功能,可直接與醫護人員、病患以繁體中文語音互動,可完成藥品配送、病房檢體運送,以及病房指引等任務。

登高一呼、將人形機器人狂熱推向新一波高峰的輝達,也是鴻海的長期合作伙伴。FoxBrain不僅在NVIDIA Hopper GPU上訓練,也透過輝達Omniverse平台上,專門為醫療系統打造的Isaac for Healthcare進行虛擬訓練與數位孿生的場域模擬。

例如,台中榮民總醫院就根據護理站和病房的實際配置製作虛擬訓練場底,讓Nurabot可先在虛擬醫院走廊練習,再進入實體世界測試。

鴻海自研VLA模型,「行動」數據仍是實體AI瓶頸

栗永徽透露,研究所也正在研發「視覺─語言─行動」(VLA)模型;也就是結合視覺感知、自然語言理解及行動控制能力的多模態模型。這對機器人執行實體任務特別有用,也是「實體AI」發展的重要一步。

但資料收集仍是一大挑戰。比起文字、影像資料,關於「行動」的資料更難大規模取得。

過往IoT累積的數據,大多用於瑕疵檢測、預測性維護,對於引導機器行動的幫助不大。栗永徽以機器手臂執行任務的過程為例,「眼睛可以看見它是怎麼動的,但看不出驅動這些動作的馬達等元件參數是什麼。」

尤其,深度機器學習需要大量資料,現行透過人為操控機械手臂,「imitation learning」(模仿學習)累積數據的方法仍像是土法煉鋼,速度有限,可見在技術突破之前,VLA模型仍將是AI走入現實的一大關卡。

從自動化改善產線,到醫療場所的護理助手,再到機器人未來的關鍵數據,FoxBrain的打擊範圍橫跨軟硬體,也將直面讓AI於實體世界移動的「數據」,期待結合全球優秀伙伴,加速全球AI自動化的浪潮。