黃仁勳日前指出中國開源模型先進,史丹佛AI指數報告也指出和美國Claude僅些微差異,引起網路熱烈討論。中美模型到底誰優秀?怎麼評估才公正?分析機構SemiAnalysis於上週25日出具報告,採取團隊實際測試中美多個模型來分析,結果發現中國DeepSeek最新V4和Claude Opus 4.7相較,只輸一個地方!到底怎麼看出來?同時還指出中國開源模型設計,會顛覆快閃記憶體?有可能讓去年DeepSeek一度讓輝達股價暴跌事件重演?買記憶體股該小心什麼?

上週,長期關注半導體與AI發展的分析機構SemiAnalysis發布報告,指出團隊親自實測GPT-5.5、Claude Opus 4.7、DeepSeek V4等多款中美頂尖模型,結果印證了黃仁勳與史丹佛2026 AI指數的觀點。中國開源模型,跟由Anthropic開發出來的Claude美系高階模型已經差距不遠了。

但是到底怎麼看出來的?為何跟一些熱愛Claude的工程師感覺大不同?

延伸閱讀:史丹佛2026AI指述說了什麼?中國開源模型與專利為何勝出?

中國DeepSeek V4只輸Claude一個地方

該團隊指出,依據他們的內部真實測試,發現中國上週才發布的DeepSeek V4開源模型,幾乎在所有測試任務上都能與Claude 最高階的Opus 4.7、以及OpenAI上週才發布的GPT-5.5相抗衡。

DeepSeek V4唯一輸的地方令人意外,竟然是中文寫作任務。在這個評比上,分析師認為Claude Opus 4.7仍然遠勝DeepSeek V4-Pro。SemiAnalysis在報告裡幽默地點破:「Claude在中文上,把中國模型打趴了。(Claude mogs Chinese models in its own language)。」

SemiAnalysis團隊還指出一個DeepSeek V4看似輸了,其實贏得漂亮的一個地方。原來,DeepSeek V4-Pro的總參數量為1.6兆、活躍參數490億,而像是美國矽谷頂尖非開源模型的實際架構規模估計遠高於此。按照一般邏輯,參數少通常意味著模型能力就更差。

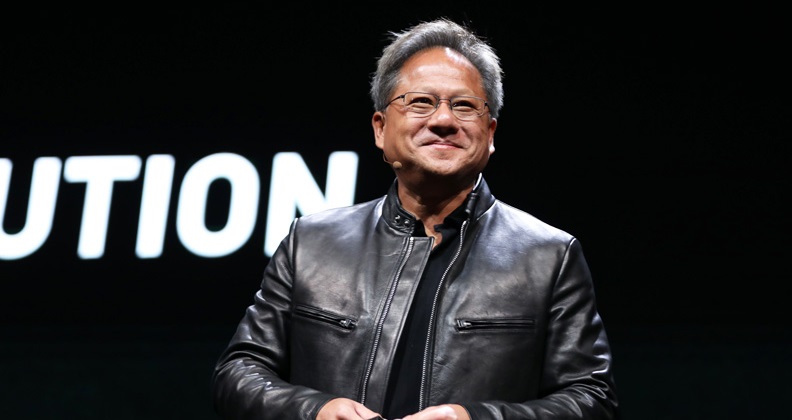

但DeepSeek的創新就在於此:他們成功證明V4-Pro這樣更小的模型,可以跑出接近遠高於自己參數規模的矽谷非開源模型任務成果。這正是黃仁勳曾在近日Podcast訪談所說「算力受限反而逼出更聰明演算法」的具體證據:中國AI團隊沒有辦法堆出更多算力,只能把每個參數的使用效率逼到極限。

更不妙的是,這款V4是跑在華為晶片上,黃仁勳預言「美國的災難」將來臨,就是說這一件事。

延伸閱讀:黃仁勳如何為中國開源模型辯護,又如何比較輝達與華為競爭力?

DeepSeeK曾讓輝達股價暴跌,這次會在記憶體股戰場重演?

另外,SemiAnalysis還指出,DeepSeek V4最核心的技術升級,會讓他們想提醒這陣子跟進記憶體股大缺貨潮的投資人,「要小心了!」為何這麼說?

原來,該團隊研究DeepSeek V4,發現該模型已可將上下文視窗從128K大幅拉長到100萬個token。也就是模型一次能記住和處理的文字量,躍升到近80萬字。就像是有能力讀完並且記得十幾本書。

為了支撐這個超長上下文,DeepSeek引入了數項注意力壓縮技術,結果讓KV快取(KV Cache)的使用量,減少了驚人的90%!

KV快取是什麼?那是大型語言模型推理時的核心記憶體需求,它負責暫存模型在處理長文本過程中產生的中間計算結果,讓模型不必每次都從頭重算。上下文愈長、模型愈大,需要的KV快取愈多,對NAND快閃記憶體的消耗也愈驚人。

所以當DeepSeek V4宣稱這項需求減少了90%,SemiAnalysis自然會在報告中提出警訊:NAND快閃記憶體投資人,要當心了。不過他們也還在觀察狀況,並沒有指出記憶體股一定會大跌。

因為許多輝達投資人可能還記得,2025年春節DeepSeek R1出現時,因為展示出用極低算力就能逼近頂尖模型的演算法突破,讓輝達單日市值急遽蒸發,多家AI概念股同步重挫,當時包括黃仁勳在內,許多執行長們紛紛跳出來反駁,指出效率提升有可能刺激更大的訂單需求。如今GPU更是空前缺貨,只能說黃仁勳這些科技領袖當初預言相當正確。

對於有買進快閃記憶體相關業者股票的投資人來說,SemiAnalysis把這次快閃記憶體的警訊,與去年R1的衝擊相提並論,也就是先埋下伏筆:這一次,快閃記憶體的需求邏輯是否同樣能自我修復,還沒有答案。但如果觀察到之後快閃記憶體需求馬上更大,也許可以稍微減少擔憂。

模型好不好,該相信測試還是真實任務?

最後,許多人恐怕會質疑,SemiAnalysis的大模型比較是怎麼做出來的?該不會只是整理業界發布大模型時通常會有的基準測試吧?這個測試的準確性被不少人質疑過。SemiAnalysis在報告中也明確地打臉指出,他們發現各家模型開發團隊做基準測試,常常會選對自己有利的項目發布、迴避不利數據,甚至在訓練階段針對特定測試集優化。

因此,他們的評估是依照內部團隊的真實測試,以及他們自己建立的追蹤儀表板「Tokenomics Dashboard」,這也顯示了這個分析機構認定一個模型的優劣,除了答案好不好,更著重在把AI的算力消耗現況與產出,翻譯成投資人能看得懂的語言,所以才能特別看出中國DeepSeek在精省上的優異設計。

不過,該團隊也認同網上工程師的看法,一個模型優不優,比起基準測試更值得參考的,是在真實任務裡的實際表現。而他們的結論是,目前仍沒有絕對的贏家。像是被公認最先進的 Claude Opus 4.7,SemiAnalysis團隊實際使用認為,該模型在理解程式碼結構和複雜推理上表現突出,但對用戶意圖的推斷不如Claude精準。目前SemiAnalysis團隊的實際做法是:先用Claude規劃架構和初版實作,再切換到GPT-5.5解決具體問題和除錯。