企業對「品質管理」的概念不陌生,但在AI 2.0時代,諸多人工智慧技術進入產品、服務中,要如何為人工智慧系統做好品質管理,達成國際合規要求?

人工智慧技術迅速發展,擴展了應用範圍,也使風險管理的重要性日漸提升。國際對人工智慧監管的框架逐漸成形,是出口導向的台灣企業們必須及早關注之事。

身為台灣人工智慧協會常務理事的TUVNORD Taiwan永續長黃國寶,1月17日以「打造可信賴的AI管理制度」為題,主持線上專講,解析歐盟AI法案(EU AI Act)規範,並參考ISO 42001提出的PDCA標準流程,制定完善的AI管理系統。講座吸引上百位與會者參加。

歐盟AI法案明年生效,最高可罰3500萬歐元

首先,黃國寶介紹歐盟AI法案,大部分法規將從2026年8月開始適用,違反法規的罰款最高可達3500萬歐元,或企業營收的7%。他強調,企業應從現在開始關注此法案,因為若企業開發一項AI產品約需要一年的時間,則至少從今年8月開始,企業就需在開發產品時符合法規要求。

歐盟AI法案將AI產品的風險分為四類,包括不可接受風險、高風險、有限風險和低風險,本次演講聚焦討論高風險AI產品,例如機械設備、醫療器材、機動車輛等,對於這些產品,企業需要建立品質管理體系,並提供合規的技術文件。

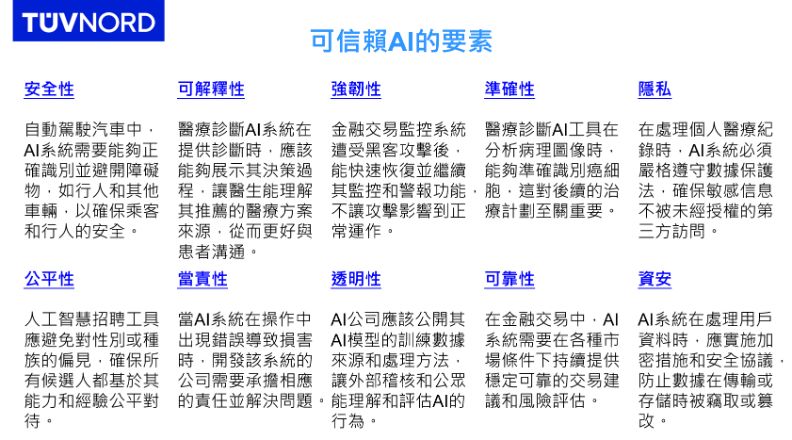

歐盟重視「可信賴AI」(Trustworthy AI)的概念,當中又可包括安全性、可解釋性、強韌性、準確性、隱私、公平性、當責性、透明性、可靠性、資安等十項要素。以醫療診斷AI系統為例,AI應該要能讓醫生理解其推薦的醫療方案,此為可解釋性;而AI系統在處理用戶資料時,應實施加密措施和安全協議,則是資安的目標。

可依照ISO42001制定AI品管流程

那麼,企業要如何建立AI產品的品質管理系統呢?國際標準化組織ISO制定的ISO42001就是可參考的管理標準。黃國寶說明,ISO42001於2023年12月發布,適用於使用AI產品的任何組織,無論其大小、性質或類型為何。此標準旨在為企業提供從建立、實施到後續維護AI管理系統的指南,幫助企業負責任地開發與使用AI產品。

ISO42001使用品質管理專案常用的「PDCA」流程,分別為計畫(Plan)、實施(Do)、維護(Check)和改善(Act),涵蓋了一項產品在管理和技術層面從無到有,再從有變好的過程。其文件中的第四至第十章節,便對應了這四個步驟,組織背景、領導力和規劃屬於「計畫」、支持和運作與「實施」有關、績效評估為「維護」的範疇,以及最後一章改進則為「改善」的部分。

建立AI管理系統不僅是為了因應新法規,對解決企業問題也有幫助。黃國寶引述了財團法人人工智慧科技基金會的調查,結果顯示,各產業在管理或業務營運上應用AI時面臨的挑戰,排行前三名為「缺乏相關技術人才」、「公司資料尚未進行整合」,以及「導入AI的金額成本太高」。他認為,這些問題經過拆解後,都能透過前述ISO42001的流程解決。

可參考ISO42001制定框架,再補充法案細節

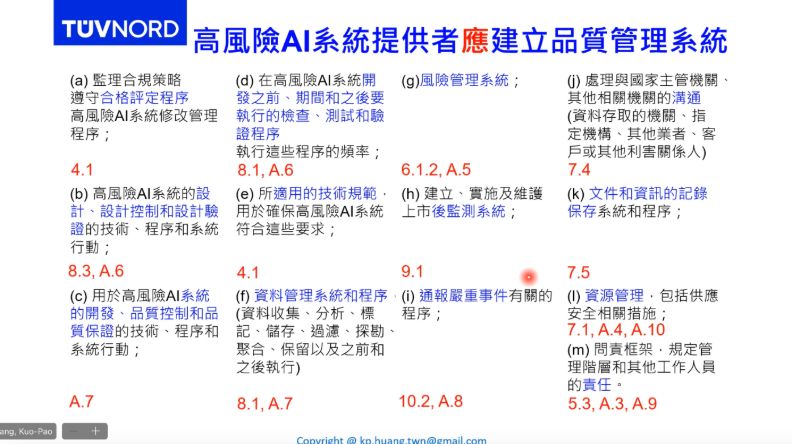

雖然ISO42001與歐盟AI法案可相互參考,但不代表按照ISO42001的流程執行,就能完全符合歐盟AI法案的要求。因為歐盟AI法案是歐盟當地的法規,ISO42001僅是一個自願性的管理標準,只是兩者剛好在相近的時間點推出,主題和訴求也有相似之處。如下圖所示,黃國寶整理了歐盟AI法案對AI品質管理系統的13項要求,並標註其對應的ISO42001章節。

東海大學法律系助理教授張凱鑫於問答環節時補充,由於歐盟AI法案較晚推出,要求的細節較多,建議企業可以按照ISO42001的框架進行,再將一些歐盟AI法案的要求納入。雖然歐盟AI法案的規定看似很多,但他認為其法規框架有參考目前業界作法,因此不會與企業原先習慣的品質管理系統差異太大。

有觀眾提問,前述提及的可信賴AI要素有些是抽象概念,例如透明性、當責性等,是否有更具體的標準可供企業參考?黃國寶回應,當這些原則應用到特定產品上時,企業要先界定客戶需求,根據真實的使用情境,擬定產品需達到的性能或規格標準。

「種一棵樹最好的時間是20年前,其次是現在。」最後,黃國寶引用這句諺語,鼓勵企業從現在開始建立AI管理系統,為未來法規要求做準備,也善盡企業的社會責任。