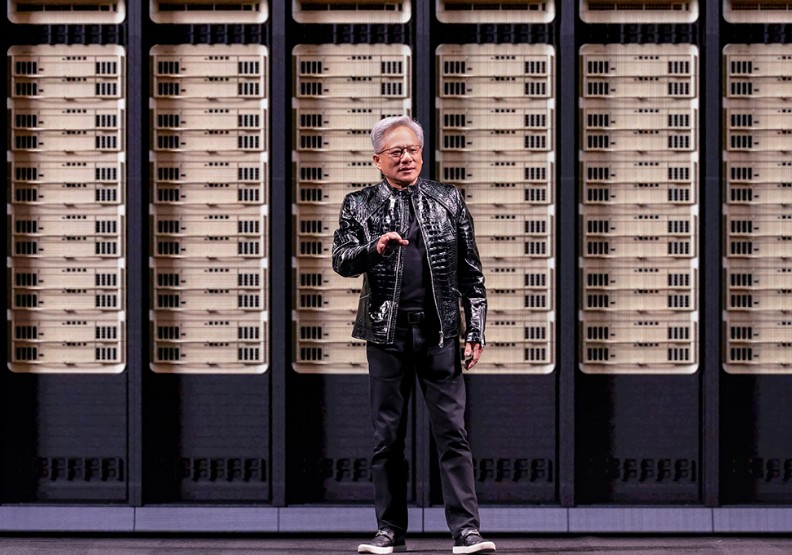

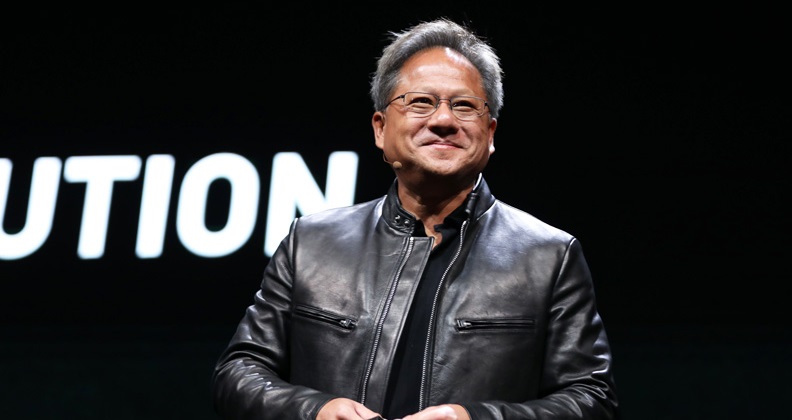

液冷散熱再度成為市場關注熱點!尤其當輝達執行長黃仁勳在CES的一席話,宣告新一代GPU機櫃架構Vera Rubin將在2026年量產,並將全面採用100%液冷架構,帶動散熱股歡欣鼓舞。在伺服器功耗需求持續攀升下,液冷的技術將如何演進?黃仁勳所說的No Chiller又是什麼意思?傳統的水冷機到底還需要嗎?《遠見》一文拆解。

隨著資料中心功耗持續上升,液冷散熱也成為市場關注的重要技術。輝達執行長黃仁勳在2026年1月的CES演講中重磅宣布,新一代GPU架構Vera Rubin將在今年全面進入量產。

根據調研機構資料,Vera Rubin機櫃的熱設計功耗(TDP)預計突破200kW,而旗艦級的Rubin Ultra更是上看1000kW(1MW)。相比上一代Blackwell架構,GB200 NVL72整機櫃的TDP約落在120kW─140kW,這意味著,Rubin世代對於散熱的需求幾乎翻倍成長。