歐盟推出全面性AI監管框架,但於內、外皆蒙受壓力。在平衡創新與安全的努力中,如何解析歐盟近來監管態度?面對歐洲市場的合規成本,企業可以如何應對?

近年來,對合規資源有限的許多中小企業與新創來說,歐洲市場似乎距離自己愈來愈遙遠。隨著人工智慧技術滲入產品、服務,以及歐盟AI法案的逐步實施,事況可能更加嚴峻。

在自家政府聲援下,富裕的美國科技巨頭對歐盟監管的批評也更加鮮明。

積極進行遊說的Meta已表明,因歐盟監管框架,延遲或限制了產品及特定功能進入歐盟市場。稍早,Meta更直言針對通用AI模型制定的「實踐守則」(code of practice),將加諸「技術上不可行的要求(technically unfeasible requirements)」。

這呼應美國副總統范斯(J.D. Vance)2月在巴黎AI峰會上的明確施壓。范斯呼籲歐洲「以樂觀而非恐懼」的態度看待人工智慧,不希望歐洲AI監管步上《一般資料保護規則》(GDPR)的後塵;他認為這讓小公司們陷入無盡合規成本或鉅額罰款風險的兩難。

在強力遊說下,試圖在風險及創新間取得平衡的歐盟近來顯露一些軟化跡象。歐盟執委會正在討論將AI法案中部份內容調整為非強制遵守,2月時亦公布撤回《人工智慧責任指令》(AI Liability Directive)等數項科技法案。

企業該如何看待歐盟層層堆疊的監管規章?新上路的AI法案,又將帶來什麼挑戰與機會?

歐盟監管法規龐雜,但各地區有不同風險

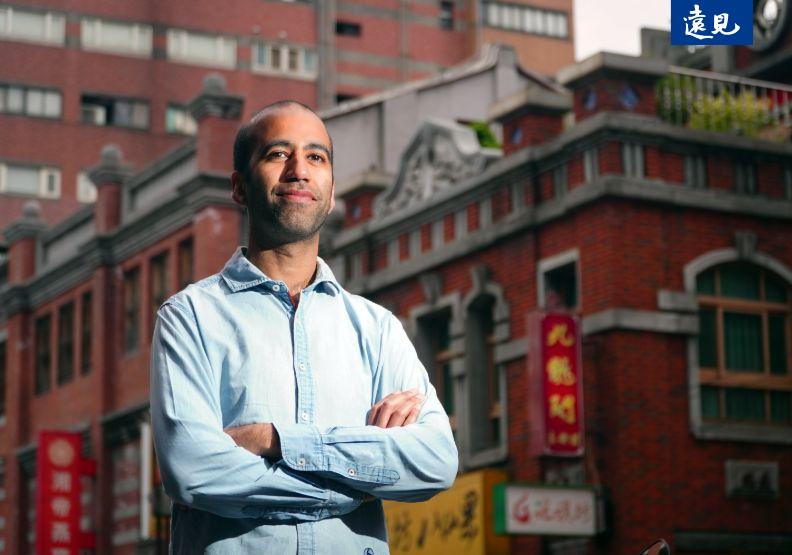

德國AI新創公司Aleph Alpha 副總法律顧問達塔(Amit Datta)以自身為例向《遠見》解釋,公司員工總數約250人,就有規模5人的法務團隊,比例上算是不小。

達塔在歐盟議會於2024年通過AI法案後不久加入Aleph Alpha。包括追蹤法案進度、參加實踐準則會議、閱讀及分析準則內容等,他估計自己花在AI法案上的時間大約佔了3~4成工時。

但經營歐洲市場的企業要面臨的監管框架遠不僅止於AI法案。達塔於「臺歐生成式AI研討會」上分析,在歐盟關乎人工智慧的監管體系中,影響最大的三項主幹分別為AI法案、《著作權指令》以及GDPR。除此之外,還有諸多其他如《數位服務法》(DSA)、《資料治理法》(DGA)等法規。

讓事況更加複雜的是,其中不少法案是在今日常見的通用人工智慧模型(GPAI)普及之前制定的。這就導致有些原則顯得不合時宜,甚至是與大語言模型(LLM)的本質相衝突。

以GDPR為例,GDPR要求資料處理具有透明度,但神經網路透過訓練資料進行深度學習的過程很難解釋清楚;也因此有「黑盒子」之稱。GDPR也包括一條個資蒐集的最小化原則,但訓練LLM需要巨量的資料。

達塔承認,即使自家產品服務不在某些法案規範範圍內,企業也需要投入資源進行全面性評估,以釐清自己有哪些法律義務及權利。而這對中小企業來說,可能已是一筆可觀的成本。

不過,達塔也指出,其他地區即使現在沒有相應法規,未來也可能會制定AI相關新法。在美國,也看見OpenAI等科技公司訴訟纏身。目前的法律爭議多聚焦在資料版權領域,但未來可能來自更多面向。這也是沒有明確法規的風險。

面對看似打擊範圍廣泛的AI法案,達塔建議企業「不需要一開始就被嚇到」,預期自己可能無力達成繁重合規要求。重要的是先進行評估,了解其中哪些部分適用於自己,再做出相關決策。資源較有限者,也可以先從官方發表的摘要文件開始,或是尋求產業公會等機構協助。

正視大眾疑慮,困難不是不加監管的理由

歐盟AI法案在國際間受到過度監管、可能抑制創新腳步的質疑,但達塔並不認為這套法案扼殺創新。他觀察,近來歐盟官方已在更深入地檢視自己的法規體系,決定不再推進《人工智慧責任指令》就是一例。

過去五到十年間,歐盟對科技加強監管。這造就了「過度監管」的印象,但也讓歐盟的工具箱中已有不少應對現有風險的選項。達塔表示,「也許我們正處於這樣的階段,比起快速地推出新的法規,先專注審視現有的框架。」

這套AI法案絕非完美,但達塔認為,想監管快速進展的科技原本就是一件艱難的任務。不應因此忽視的是,「大眾對人工智慧是有著恐懼的。」

人們擔憂AI會危及自己的工作權益,擔心AI生成的假訊息會在資訊空間中恣意流竄,到了虛實難辨的程度。達塔認為,「這些疑慮是應該被處理的。」

例如,AI法案中明訂部分AI應用為「不可接受的風險」。可能導致不公平待遇的社會評分系統便屬於此範疇。達塔認為,這樣的做法與歐洲的價值觀與基本權利相違背,「社會共同做出禁止這類系統的決策,我認為這是重要的。」

用AI提供合規服務將成趨勢?

即便在沒有歐盟這類AI法案的國家,台灣人工智慧學校基金會秘書長侯宜秀認為,人工智慧產品及服務的安全性標準,是真實存在的需求。從資料安全到模型表現,侯宜秀表示,「AI的安全性會是一個產業。」

身處歐盟的Aleph Alpha肩負合規義務,也將合規化作一門生意。自2024年起與資誠合作推出的Creance.ai,就是一項以AI為基礎的合規解決方案。目前的第一項用例,是可以自動化檢查第三方合約是否符合歐盟法規的DORA。

達塔解釋,DORA不僅能辨識一份合約合規與否,也能標註哪些內容可能有不合規疑慮。「你還是需要人類律師,(保持人為監督)也是我們的基本方針。」達塔說,「但比起靠十名律師人工審查,現在可能只需要一名律師檢查結果。」

企業合規存在許多需要頻繁評估的工作,想純靠人力完成所有任務,是愈來愈不切實際的作法。達塔觀察,市場上對AI輔助的合規服務的需求非常龐大,也有愈來愈多公司提供類似服務。

Creance.ai也將持續拓展更多用例。達塔表示,目前市場還在評估階段,但客戶對首波服務的反應良好。「這效率更高,成本更低,也非常透明。」達塔說,「在市場上已經可以看見真實的價值。」