歷年最強的COMPUTEX今(4)日登場,全台吹起AI旋風!輝達(NVIDIA)執行長黃仁勳6月2日在台大體育館發表主題演講,至今仍令人費心解鎖其中的專業名詞,如:「執行長(CEO)數學」、數位人類、Omniverse數位孿生平台、新一代GPU平台Rubin,以及黃仁勳不斷提及的CUDA等,這些名詞背後藏著什麼意涵?跟整體AI趨勢有何關聯?以下,《遠見》拆解「老黃」的AI新世界。>>【專題報導》2024 Computex最強科技巨擘齊聚盛會】

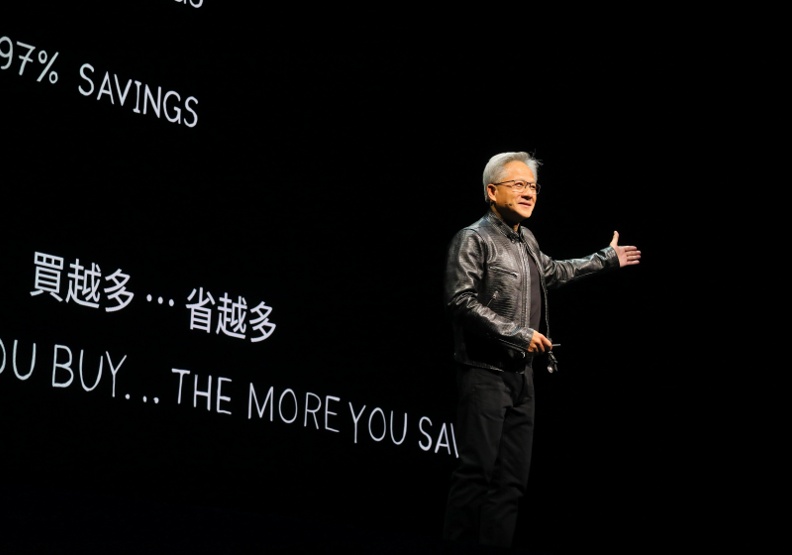

買愈多省愈多!黃仁勳解析「執行長數學」

黃仁勳指出,隨著資料不斷增加,運算效能若無法提升,世界將面臨運算通膨,而繪圖處理器(GPU)可以把過去的損失彌補回來,「買得愈多,省得愈多!這就是所謂的執行長數學(CEO Math),它不準確,但卻是正確的。」

什麼是執行長數學呢?根據《商業內幕》分析,黃仁勳在解釋這項觀念時,先說明了公司為何要同時投資GPU和中央處理器(CPU),因為這兩種處理器可以自主運作,將執行一項任務的時間從「100單位縮減到1單位」。

在個人運算產業中,將這兩種處理器結合在一起已經是很常見的作法,「我們在一台價值1000美元的電腦上裝上一個價值500美元的GPU,效能會因此大大提升,」黃仁勳說:「我們在資料中心就是這樣做的,一座價值10億美元的資料中心,我們就會加上5億美元的GPU,它就變成一座AI工廠。」

黃仁勳也展示了一張圖表,顯示當公司同時使用這兩種處理器,運算速度將會提高100倍,但成本只會是原來的1.5倍。

輝達在今年3月就發表了要價7萬美元的Blackwell B200 GPU,號稱是「地表最強的AI晶片」,只要將這個晶片封裝到GB200 NVL72中,就能將成本和耗能降低25倍。

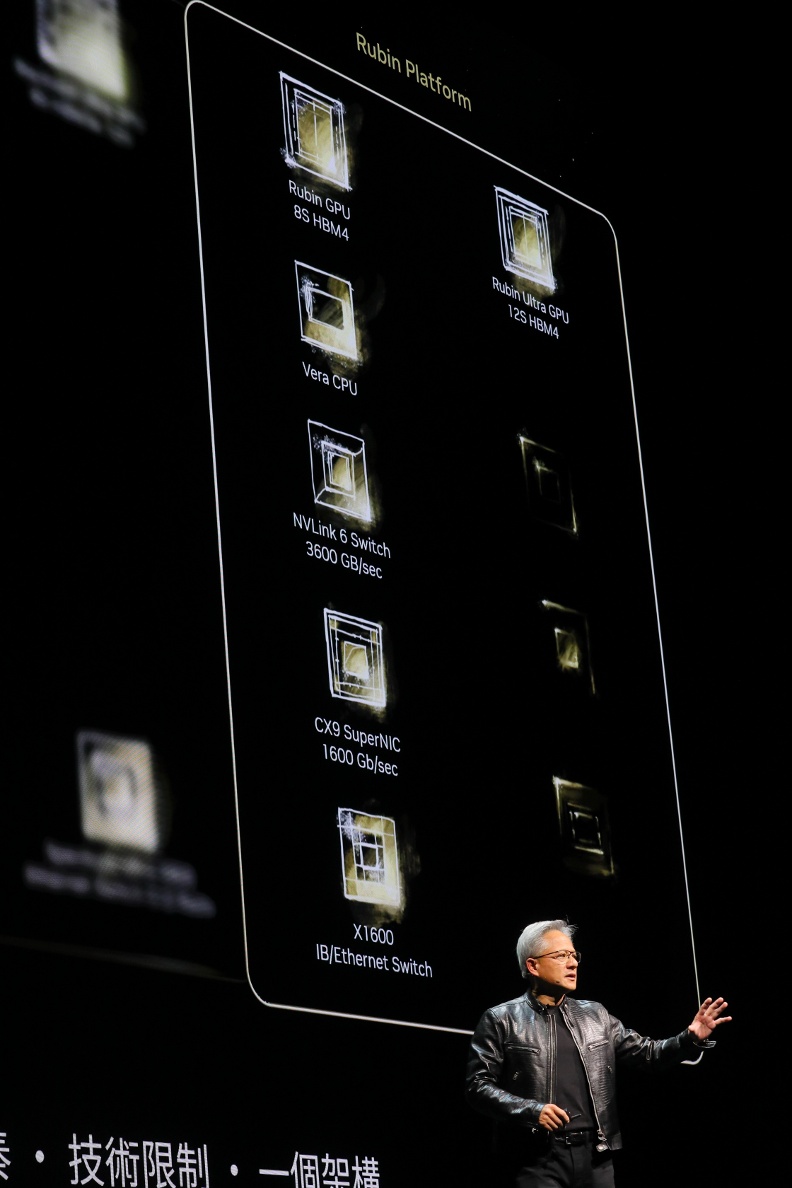

新一代GPU平台Rubin

繼Blackwell之後,黃仁勳也透露下一代GPU平台,代碼將會是「Rubin」,明年(2025)將會先推出Blackwell Ultra晶片,2026年則推出Rubin。

根據《彭博》報導,Rubin GPU將採用高頻寬記憶體HBM4,不過黃仁勳未透露更多細節。

「我認為推出Rubin是非常聰明的決定,這表明輝達將會每年推出新的GPU平台,」美國科技業諮詢公司Futurum Group執行長兼首席分析師紐曼(Dan Newman)說:「黃仁勳清楚創新的節奏,以及公司對軟體、封裝和合作關係的追求,這鞏固了他們領頭羊的地位。」

幫台灣預測颱風!NVIDIA Earth-2速度比傳統快1000倍

時常遭受颱風肆虐的台灣有福了!黃仁勳在演講中展示了生成式AI模型「NVIDIA Earth-2」,透過高解析度的生成,來預測天氣,我國的中央氣象署也已經用來預測颱風登陸地點。

此外,根據輝達官網指出,Omniverse數位孿生平台也能提供大規模和高擬真的互動視覺化體驗,來呈現全球天氣狀況。

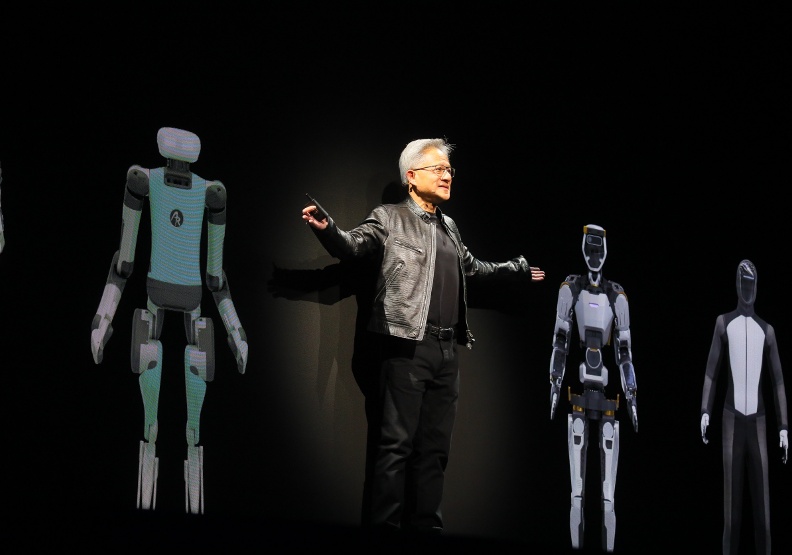

Omniverse數位孿生平台打造「AI機器人工廠」

至於Omniverse又是什麼東西呢?

根據輝達官網指出, Omniverse是連接和開發「通用場景描述」(OpenUSD)應用程式的平台,讓開發人員能夠將OpenUSD和RTX渲染技術整合到現有的軟體工具和模擬工作流程,來打造AI系統。

黃仁勳說,機器人需要透過人類反饋來學習,輝達的Omniverse數位孿生平台,就能讓機器人在模擬世界中精進實力,「讓機器人學習如何成為機器人。」

舉例來說,Omniverse可以部署在自駕車上,增加感測器模擬能力,藉此提升安全性並降低成本。

黃仁勳在演講中補充,鴻海將透過輝達的Omniverse平台、德國西門子的數位孿生技術以及其他AI套件工具,打造AI機器人工廠。

可大幅提升運算效能的CUDA

黃仁勳演講全程不斷提及的CUDA(Compute Unified Device Architecture,統一計算架構),其實就是輝達研發的平行運算平台及編程模型,可利用GPU的能力大幅提升運算效能。

CUDA的應用範圍相當廣泛,包括圖像和影片處理、計算生物化學、流體動力學模擬和地震分析等。

而這次黃仁勳在演講中提到,為了加速部署AI應用和保障資料安全,輝達推出推論微服務「NIM」(NVIDIA Inference Microservices),其中的訓練模型就包括CUDA。

輝達表示,企業甚至還能使用NIM來加速新藥的發現,數十家醫藥公司也正在部署NIM,來推動一系列的應用,包括手術規劃、數位助理和臨床試驗優化。