抓到了!上週四,美國南卡羅萊納州當地大學哲學系助理教授哈德森在臉書上發表示,有學生用ChatGPT寫作業被他發現,這些抄作業事件讓AI工具變得愈來愈爭議,另外也有人認為這工具會被用來做假訊息攻擊。於是,開發團隊OpenAI最近也祭出這個新功能,防治ChatGPT代筆浮濫現象。

由OpenAI開發、12月初橫空出世的ChatGPT,在推出後便引發熱潮,「取代冗贅工作」「解放人類心智」「取代Google地位」,一時之間,出現大量對於ChatGPT應用的樂觀預期。

技術是中立的,只要有人,就會有陰暗面。隨著使用者更加熟悉ChatGPT的運作,開始出現不正當的用途。如果人工智慧被用來逞凶作亂,甚至直接對人類不利,我們的社會該如何迎擊?

學生用ChatGPT寫作業:現在還能分辨,但AI只會更強大

上週四(12月16日),美國南卡羅萊納州格林維爾傅爾曼大學(Furman University)哲學系的訪問助理教授哈德森(Darren Hudson Hick)在自己的臉書上發文表示,有學生用ChatGPT寫作業被他抓到了。

哈德森以「休謨(David Hume)和恐怖悖論」為題,要求學生撰寫500字的短文。在交上來的作業中,有篇文章寫得頭頭是道,不僅句法連貫,而且學生確實知道關於休謨的一些事實,也嘗試描述了休謨對於恐怖悖論的觀點。但哈德森說,對於熟悉相關領域的人而言,前面的內容還可一讀,但後面開始就都在鬼扯(bullshit)。

「不知道休謨對恐怖悖論有何看法的人,這份作業是完全可以讀的,甚至令人信服。只是對熟悉此主題的人來說,文章內容就會啟人疑竇。」哈德森指出,除了學術專業讓他能夠判斷真偽以外,ChatGPT目前還不善於引用,這對於哲學系的進階課程來說是件好事,因為相關素材相對複雜且難懂;但對於入門課程來說,無論領域,ChatGPT可能顛覆一切。

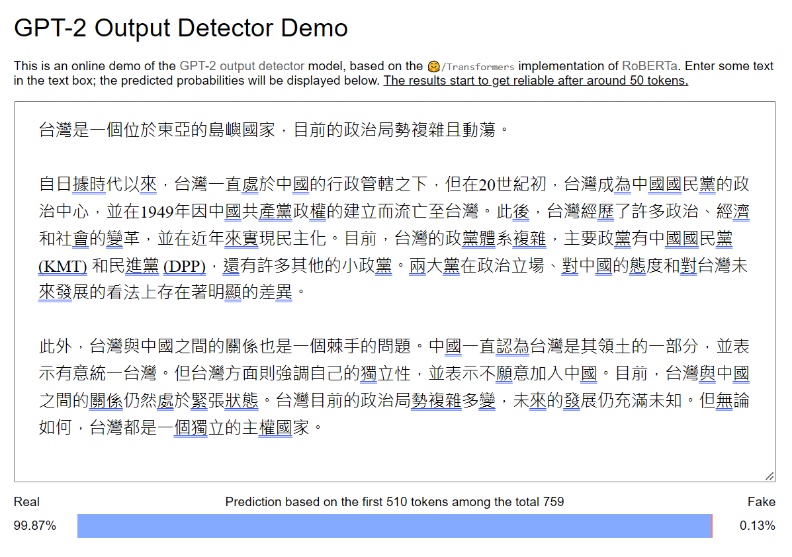

因為心生懷疑,哈德森把該篇作業放進人工智慧公司Hugging Face開發的「GPT檢測器」,該工具判定這篇報告為機器生成的可能性高達99.9%。他詢問學生後,學生承認作業確實是由ChatGPT所生成。

雖然哈德森守門成功,攔下這份由人工智慧寫出的作業,但以後能否繼續維護學術誠信,他認為前景並不樂觀。對於未來ChatGPT的學術不端應用,他預期那「將會是一場洪水,不只是涓涓細流。」畢竟完成一篇作業,只要短短5分鐘。

哈德森表示,ChatGPT距離釋出只有三週,接下來一定會持續進步,到時人們更難分辨到底作業是人類還是人工智慧所寫。哈德森希望學校管理層能夠盡快制定標準處理問題,在官方推出規範以前,他會要求學生口頭解釋作業內容,作為應急方案。

AI被拿來做壞事

這並不是人工智慧第一次被拿來做壞事。

能用來生成人像、聲音,甚至影片的深度偽造技術(deepfake),已經有許多惡意用途,例如讓政客說出他們從沒說過的話、合成名人頭像至色情影片、商業上假冒他人等,且深偽技術不只有在國外發展,台灣也出現案例。

為了讓大眾認識深偽的可怕,2018年時美國媒體Buzzfeed和導演皮爾(Jordan Peele)合作,以深偽技術製作出「歐巴馬介紹深偽」的影片,並做出實際示範,讓歐巴馬出聲攻擊「川普就是個蠢蛋。」其製作精細程度引人讚嘆,但更讓人毛骨悚然。

2021年,歐洲國會議員和俄國反對派大將沃爾科夫(Leonid Volkov)線上通話,事後才發現對方可能是深偽技術創造出的替身。今年(2022)3月,社群媒體上流傳了烏克蘭總統澤倫斯基(Volodymyr Zelenskyy)呼籲國民投降的影片,事後烏克蘭政府趕緊澄清。

不過,比起政治與商業用途,深偽更常被用於偽造女性的成人影片。根據Sensity AI釋出的2019年深偽報告,有96%的深偽影片為非合意的色情影片,且幾乎都是女性。2021年,台灣網紅小玉(朱玉宸)因為將台灣女性名人合成至色情影片而遭起訴,今年7月法院判決出爐,依照違反《個人資料保護法》判處5年6個月徒刑。

雖然法律能夠制裁犯罪者,但現行法律仍有不足之處,而且這些傷害也難以復原。正如同深偽報告中所提,「深偽技術被用來當作對付女人的武器,它讓人感到恐懼、羞辱、被貶低,並且因此被噤聲。這些色情影片向女人表達,她們的身體不屬於自己,也讓女人們難以繼續待在網路上,也更難找工作,遑論感到安全。」

研發限制AI的武器,來得及嗎?

考慮到深偽對社會造成的影響,學界和業界都投入資源應對。舉例來說,Google在其線上運算環境Colab上限制使用者訓練深偽模型,微軟則推出能夠計算影片可信度分數的工具,Meta在臉書上禁止深偽影片,推特則封鎖了部分固定發表深偽影片的帳號。

相似的,開發出ChatGPT的OpenAI目前也正在想辦法限制旗下產品的影響力。ChatGPT的惡意用途不只有學術不端行為,考慮到它在語言上的能力,若是在戰爭時期大量散播似真實假的謠言,或者是被用來指導製造武器(例如有人以寫小說維明請教該如何製作汽油彈,ChatGPT給出精準的指引),後果不堪設想。

OpenAI的客座研究員、美國德克薩斯大學奧斯汀分校(University of Texas at Austin)電腦科學系教授艾倫森(Scott Aaronson)表示,OpenAI現在試圖在ChatGPT生產的文字中,加入類似浮水印(watermark)但又難以發現的秘密訊號,希望能夠讓人們有辦法辨別。

艾倫森在他的部落格文章中提到,「想想俄國入侵烏克蘭時的大量支持留言吧,」若是有了浮水印,至少人們可以藉此知道文章背後的作者是不是真人,因而有效減緩對於ChatGPT的濫用。

面對技術革新以及伴隨而來的負面影響,科學家已經著手對抗。但陰暗角落滲出的惡意從不放棄,以深偽來說,研究者便預期將會出現更多規避偵測的新模型出現。面對中立且不斷進步的技術,想要禁止本就有一定難度,認識並且了解相關發展,會是一個好的開始。